Благодаря развитию искусственного интеллекта появятся новые рабочие места и другие специальности. Они потребуют от людей способности «воспитывать» машины. Возможно ли это, и кто это будет делать?

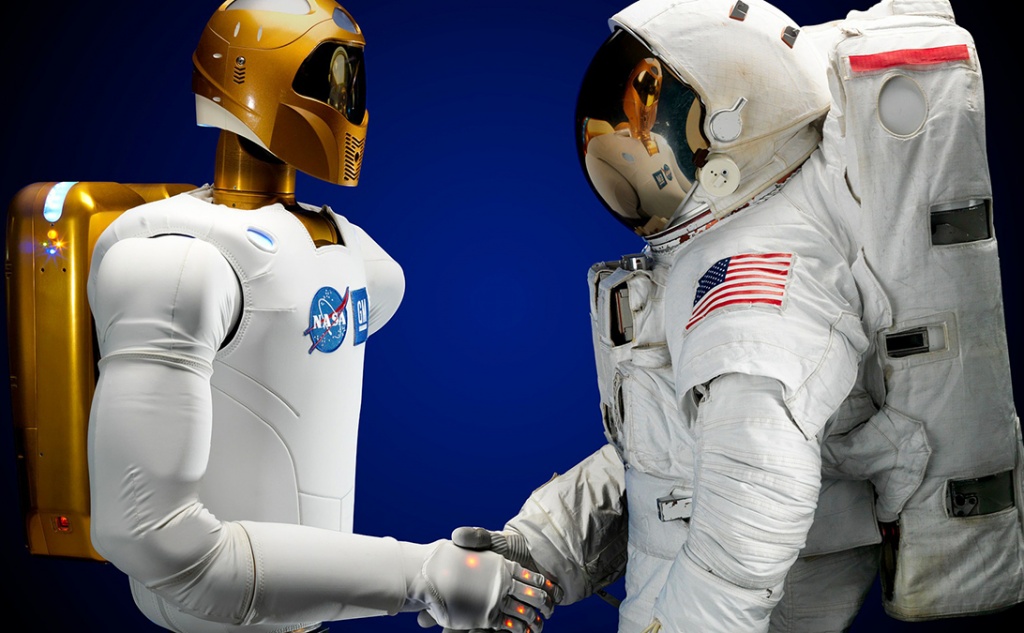

Искусственный интеллект становится умнее, он научился писать музыку, играть в компьютерные игры, рисовать картины. Однако способность к вычислениям и творчеству еще не гарантирует умным машинам успешного «трудоустройства». Для успешного соседства с человеком роботам необходимо научиться чувствовать, и в этом им потребуется помощь. По мере развития ИИ-решений пропорционально будет расти и окно возможностей для профессионального развития людей в этой области.

Специалисты по эмпатии

Чат-ботов вроде Siri и Alexa смогут обучать специалисты по эмпатии. Это позволит реагировать на вопросы людей с глубоким пониманием, состраданием и даже юмором. Психологи выделяют три основных вида эмпатии.

- Эмоциональная – это способность переживать те же чувства. У человека она возникает еще в младенческом возрасте: когда плачет один ребенок, начинает плакать другой.

- Когнитивная – способность поставить себя на место другого человека и понять, как он думает. Это интеллектуальный процесс, который уже далек от непроизвольной реакции.

- Эмпатическая забота – способность, которая побуждает заботиться о других людях и помогать.

Очевидно, что самой «трудно программируемой» окажется эмпатия первого типа. У роботов просто нет врожденных чувств. Однако на эту проблему стоит посмотреть с другой стороны: действительно ли это качество необходимо умным машинам? В исследовании ученые из университета Миннесоты не обнаружили взаимосвязи между агрессией и низким уровнем эмпатии. Оказалось, что агрессивными людей делает не отсутствие сопереживания, а слабый контроль над импульсами и эмоциями.

Следовательно, вопрос лишь в когнитивной эмпатии и заботе. В этом случае необходимо решить проблему «предвзятости искусственного интеллекта» (AI bias), об этом мы уже подробно рассказывали.

Специалист по обучению мировоззрению и локализации

Чат-боты будущего должны считывать локальную специфику региона и общества, в которых они работают. Как правило, людям, работающим за рубежом, необходимо изучить менталитет жителей другой страны, их культурные коды. Боты также должны быть чувствительными к различиям между людьми из разных стран мира.

Так, жители США и Западной Европы часто испытывают беспокойство по поводу роста автоматизации. Они привыкли к более персонализированному сервису, в то время как японцы восхищаются роботами и ощущают культурную близость с ними.

Yeshi – бот для Facebook Messenger, созданный благотворительной организацией Charity: Water совместно с компанией Lokai. Он ведет диалог от имени девочки из Эфиопии, которая вынуждена по 2,5 часа в день ходить в поисках чистой воды.

Авиаперевозчик KLM научил своего чат-бота в Facebook Messenger регистрировать пассажиров на рейс, показывать достопримечательности, еду, банкоматы и другие полезные туристу мелочи в ответ на эмодзи.

A.L.I.C.E. (Artificial Linguistic Internet Computer Entity) – виртуальный чатбот, уже несколько лет входящий в тройку лучших чатботов мира, способен вести беседу практически на естественном человеческом языке. Для этого система сопоставляет фразы пользователя с образцами в базе знаний при помощи эвристического метода.

Специалист по интерпретации алгоритмов

Если система совершает ошибку, специалисту необходимо определить алгоритм, который к ней привел, и внести необходимые коррективы.

Norman – алгоритм, который обучен распознавать и интерпретировать фотографии и прочие изображения. Но это не обычный пример искусственного интеллекта (ИИ). Norman во всем видит ужасы. Например – стая птиц на ветке дерева. Norman, изучая то же самое изображение, видит человека, которого пытают током.

Психопатический алгоритм разработали исследователи Массачусетского технологического института (MIT). Ученые выясняли, как повлияют на восприятие мира искусственным интеллектом фотографии и изображения из темных уголков Интернета.

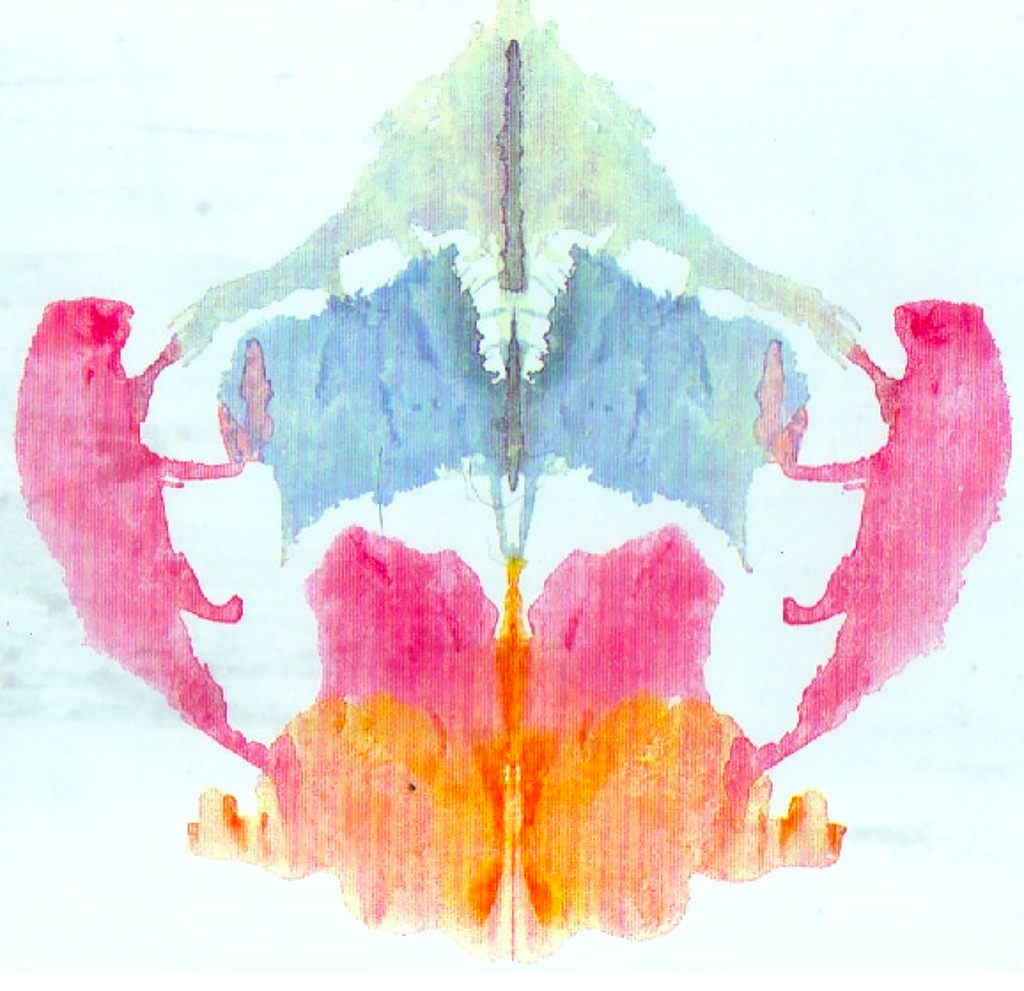

Для этого в базу данных загрузили фотографии людей, погибающих в ужасающих обстоятельствах. Затем алгоритму, который научился распознавать изображения и описывать, что он видит, представили тест Роршаха: симметричные относительно вертикальной оси чернильные кляксы разных цветов. Он используется, чтобы понять, насколько позитивно или негативно человек относится к окружающему миру.

В то время как Norman видел ужасы в каждой такой кляксе, другой алгоритм, который «учился» на позитивных фотографиях, распознавал на снимках людей и животных.

Тот факт, что Norman видит только ужасы, демонстрирует одну из фундаментальных проблем процесса машинного обучения, считает профессор Массачусетского технологического института Ияд Рахван. «Набор исходных данных важнее самого алгоритма, – говорит он. – Отбор информации, применяемой для тренировки искусственного интеллекта, отражается на том, как этот искусственный интеллект воспринимает окружающий его мир и к каким выводам он приходит».

Профессор Разван говорит, что эксперимент с Norman демонстрирует, что программисты должны найти какой-то способ балансировать входящую информацию.

Согласно исследованию Genpact, чем чаще люди используют ИИ-решения в своей жизни, тем больше они склонны им доверять. 41% опрошенных заявили, что ИИ-решения изменили некоторые важные аспекты их повседневности, 35% оценили эти изменения как положительные. Негативно к ИИ настроены лишь 11%. ИИ радикально преобразит процесс профессионального обучения, открыв новые возможности для реализации своего потенциала.